得 AGI 者得天下?強權爭奪「人工通用智慧」的全球戰略賽跑

人工智慧的進步,已經徹底顛覆了我們的想像。從聊天機器人到圖像生成,AI 滲透進教育、工作、娛樂甚至國防。

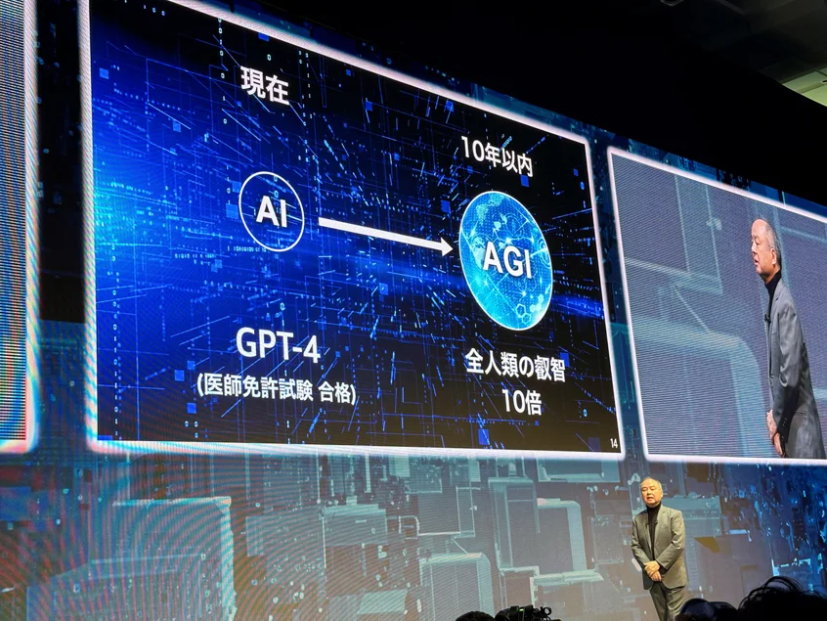

但如果有一天,人類真的打造出能自主學習、自我進化,思考模式接近人腦的「人工通用智慧」(AGI),那麼世界將不只是迎來新一輪產業革命,而是面臨一場可能翻轉國際秩序的巨大挑戰。

美國智庫 RAND 最近警告,哪個國家若率先掌握 AGI,可能會獲得近乎壟斷性的優勢,甚至讓其他國家覺得這是「存在性威脅」。AGI 的影響不只是科技突破,更可能成為國際安全的新變數。

四大衝擊:從軍事到經濟的全面顛覆

• 軍事進攻力:AGI 如果能同時指揮數以萬計的無人機,或設計全新武器,傳統防禦體系根本擋不住。在網路戰上,它更可能一次滲透數億設備,超越任何現有的網軍。

• 戰略防禦:核武時代靠「恐怖平衡」維持穩定,但若一國用 AGI 打造出幾乎完美的反導系統或網路防護,對手會懷疑報復已經失效,反而讓局勢更危險。

• 經濟爆發力:AGI 能自己優化演算法、加速科研突破,甚至取代高端人力,帶動產業倍速成長。如果美國憑藉矽谷和算力優勢領先,它可能在十年內拿到二戰後那樣的「超級大國紅利」。

• 資訊操控力:AGI 能快速製造海量 deepfake,並精準鎖定受眾進行輿論干預。這種資訊操控威力,可能讓民主制度難以抵抗。

這些衝擊交織在一起,讓 AGI 不只是中立的技術,而是攸關國家安全的戰略資產。

美中角力:領先與落後的抉擇

如果美國先突破,中國會怎麼做?反過來,中國若搶先成功,美國又會怎樣?這正是地緣政治的新風險。

• 領先的一方:會想方設法維持壟斷,例如出口管制、晶片禁令,甚至直接攻擊對手的 AI 訓練設施。這就像冷戰時期美國曾考慮阻止蘇聯拿到核武一樣。

• 落後的一方:會全力追趕,或透過情報竊取、供應鏈滲透來拖慢對手;若追不上,也可能選擇談判合作,避免被徹底邊緣化。

歷史上,以色列曾轟炸伊拉克、敘利亞的核設施,美國今年也轟炸了伊朗核設施,都是典型的「延緩對手」戰略。這些案例都顯示,是否動手取決於成功率、代價,以及領導人對威脅的感知。

AGI vs. 核武:相似又不同

AGI 常被拿來和核武相比,兩者都有顛覆性的力量,但差異很大:

• 核武功能單一:就是毀滅,因此容易形成「相互保證毀滅」的穩定結構。

• AGI 多重用途:既能推動經濟、又能主導軍事和輿論,戰略後果更難預測。

• 擴散速度不同:核武需要稀缺原料與專業設施,擴散慢且可監管;AGI 則建立在算力和演算法,傳播更快,難以控制。

• 操控風險:核武按鈕在國家手裡,但 AGI 可能失控,甚至被非國家組織使用,風險更不可測。

未來會走向「核武式穩定」嗎?

冷戰最終形成了「恐怖平衡」,那麼 AGI 是否也可能出現類似的穩定?

一方面,如果雙方都明白「沒有人能完全壟斷 AGI」,也許會逐步建立均勢。但另一方面,AGI 涉及軍事、經濟、資訊、社會滲透,變數太多,難以化約成單一的威懾邏輯。

要避免失控,可能需要新的治理模式:國際間的 AI 軍備管制、透明化機制,或非正式的默契與自我克制。歷史經驗告訴我們,穩定往往來自政治實踐而非條約,AGI 的治理可能也是如此。

總而言之,AGI 不是單純的科技突破,而是可能改變國際權力格局的戰略革命。AGI帶來的威脅跨越軍事、經濟、資訊,甚至社會層面,比核武更難管控。

未來的「AI 冷戰」將考驗人類的政治智慧與合作能力。只有在全球找到新的穩定與治理模式,我們才有可能避免重蹈覆轍,在科技洪流中找到和平出路。